OpenHarness: Biến LLM thành AI Agent 'biết làm việc' thực sự

TL;DR

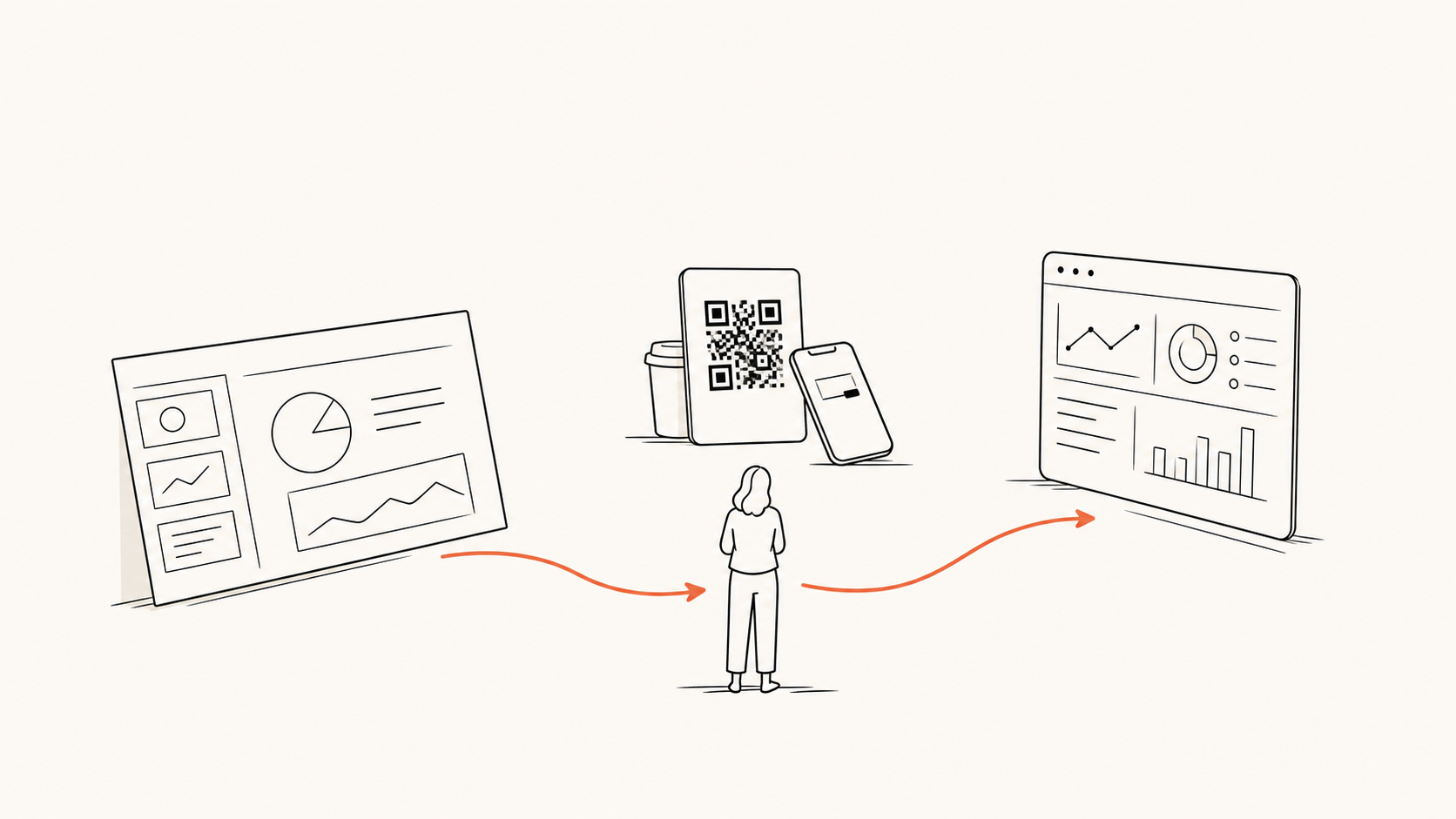

OpenHarness là một framework mã nguồn mở, cung cấp hạ tầng cần thiết để biến LLM thành một AI agent hoàn chỉnh, có “tay chân, mắt, não” để thực hiện các tác vụ phức tạp. Nó giúp bạn xây dựng các agent có khả năng dùng tool, ghi nhớ, và phối hợp với nhau mà hông cần phải tự code lại từ đầu.

Nói đơn giản: Như có một bộ xương, hệ thần kinh và giác quan cho con AI của bạn, giúp nó từ “đứa trẻ sơ sinh” thành “người lớn biết làm việc”.

Tổng quan

OpenHarness (viết tắt là oh) là một dự án mã nguồn mở từ HKUDS, được thiết kế để cung cấp hạ tầng cốt lõi cho việc phát triển AI agent. Thay vì chỉ là một “bộ não” (LLM), OpenHarness biến LLM thành một agent có đầy đủ chức năng bằng cách trang bị cho nó tool-use (tay), skills (kiến thức), memory (trí nhớ) và khả năng phối hợp đa agent (làm việc nhóm).

Điểm đặc biệt của OpenHarness là nó tập trung vào khái niệm “Agent Harness” – tức là toàn bộ hạ tầng bao bọc quanh LLM để biến nó thành một tác nhân thực thụ. LLM sẽ lo phần “trí thông minh” còn harness sẽ lo phần “thực thi” một cách an toàn và hiệu quả. Hiện tại, OpenHarness đã có hơn 43 công cụ tích hợp, hỗ trợ nhiều nền tảng LLM như Anthropic, OpenAI-compatible (GPT, Qwen, Llama…) và cả GitHub Copilot.

Dự án này rất phù hợp cho các dev, researcher hay bất kỳ ai muốn tìm hiểu sâu về cách AI agent hoạt động, muốn thử nghiệm các mô hình phối hợp agent hay đơn giản là muốn xây dựng một agent chuyên biệt dựa trên một kiến trúc đã được kiểm chứng.

Xài vào việc gì?

Muốn LLM tự động thực hiện các tác vụ dev phức tạp

Chạy oh -p "Inspect this repository and list the top 3 refactors" → OpenHarness sẽ cho LLM quyền đọc file, chạy lệnh shell để phân tích codebase, sau đó tổng hợp và đưa ra đề xuất. Thay vì mình phải tự làm thủ công, con AI nó tự động đọc code, tìm điểm cần refactor giùm mình.

Cần AI nhớ bối cảnh (context) qua nhiều phiên làm việc

Bạn có thể dùng tính năng MEMORY.md Persistent Memory của OpenHarness. Ví dụ, bạn đang debug một bug phức tạp, con AI sẽ nhớ các bước bạn đã thử, các lỗi đã gặp từ phiên trước. Lần sau quay lại, nó hông hỏi lại từ đầu, tiết kiệm thời gian đáng kể.

Muốn kiểm soát chặt chẽ những gì AI được phép làm

OpenHarness có hệ thống Governance với các chế độ permission đa cấp. Ví dụ, bạn có thể đặt Plan Mode để AI chỉ được phép đọc và lên kế hoạch, hông được ghi hay thực thi lệnh nguy hiểm. Điều này giúp mình an tâm hơn khi cho AI tương tác với hệ thống thật.

Cần AI tự học và áp dụng kiến thức chuyên môn khi cần

Hệ thống Skills của OpenHarness cho phép bạn định nghĩa các file .md chứa kiến thức hoặc quy trình chuyên biệt. Khi LLM gặp một vấn đề liên quan, nó sẽ tự động “load” skill đó để áp dụng. Ví dụ, có skill commit để tạo commit Git chuẩn, skill debug để sửa lỗi hệ thống.

Muốn nhiều AI agent làm việc nhóm để giải quyết một task lớn

Với Swarm Coordination, bạn có thể tạo các subagent và giao việc cho chúng. Ví dụ, một agent chính lên kế hoạch, sau đó “đẻ” ra một subagent lo phần code, một subagent khác lo phần test. Điều này giúp scale khả năng giải quyết vấn đề của AI lên nhiều lần.

Các điểm chính

- Harness là bộ xương cho LLM: LLM chỉ là “bộ não” cung cấp trí thông minh, còn OpenHarness là “bộ xương” và “tay chân” (tool-use), “mắt” (quan sát), “trí nhớ” (memory) và “giới hạn an toàn” (governance) để LLM có thể hoạt động như một agent hoàn chỉnh.

- Hệ thống tool đa dạng (43+): OpenHarness tích hợp sẵn hơn 43 công cụ từ đọc/ghi file, chạy lệnh shell, tìm kiếm web, đến quản lý tác vụ và phối hợp agent. Bạn có thể dễ dàng mở rộng thêm tool của mình.

- Skills on-demand, tự học: AI có thể tự động tải và sử dụng các “kỹ năng” (skills) được định nghĩa trong file

.mdkhi cần thiết, giúp nó nắm bắt kiến thức chuyên môn mà hông cần phải “học lại” từ đầu. - Memory bền bỉ qua các phiên: Với

MEMORY.md Persistent Memory, agent có thể ghi nhớ lịch sử tương tác, bối cảnh công việc qua nhiều phiên làm việc, giúp các cuộc trò chuyện và tác vụ được liền mạch, hông bị ngắt quãng. - Kiểm soát an toàn chặt chẽ (Governance): OpenHarness cung cấp nhiều chế độ quyền hạn (permissions), từ hỏi ý kiến trước khi thực thi đến cho phép mọi thứ trong môi trường sandbox, hoặc chặn hoàn toàn các lệnh ghi/thực thi trong

Plan Mode. Điều này giúp mình kiểm soát rủi ro khi cho AI tương tác với hệ thống. - Tương thích đa nền tảng LLM: Bạn có thể xài OpenHarness với các API của Anthropic (mặc định), các mô hình tương thích OpenAI (GPT-4o, Qwen, Llama, DeepSeek, Ollama…) và thậm chí là tài khoản GitHub Copilot của bạn. Điều này mang lại sự linh hoạt cực lớn.

- Mã nguồn mở & Cộng đồng: Là một dự án mã nguồn mở, OpenHarness khuyến khích cộng đồng đóng góp, giúp mình có thể hiểu rõ cách nó hoạt động, tùy chỉnh và mở rộng theo nhu cầu riêng.

Workflow gợi ý

- Cài đặt nhanh & Chạy thử:

- Chỉ cần một lệnh

curl -fsSL https://raw.githubusercontent.com/HKUDS/OpenHarness/main/scripts/install.sh | bashđể cài đặt OpenHarness. - Sau đó, bạn có thể chạy ngay một demo bằng lệnh

ANTHROPIC_API_KEY=your_key uv run oh -p "Inspect this repository and list the top 3 refactors"để xem agent hoạt động.

- Chỉ cần một lệnh

- Cấu hình LLM & Môi trường:

- Thiết lập API key và base URL cho LLM bạn muốn xài (ví dụ:

export OPENAI_API_KEY=sk-xxx,export OPENHARNESS_BASE_URL=...). - Thử nghiệm với các

output-formatnhưjsonhoặcstream-jsonđể tích hợp vào các workflow tự động hóa khác của mình.

- Thiết lập API key và base URL cho LLM bạn muốn xài (ví dụ:

- Mở rộng với Tools & Skills:

- Tạo một tool tùy chỉnh bằng Python để giải quyết một vấn đề nghiệp vụ đặc thù của bạn.

- Viết các file

.mdđể định nghĩa các skill chuyên môn, sau đó đặt chúng vào thư mục~/.openharness/skills/để agent có thể tự động học và sử dụng. - Thử nghiệm các plugin có sẵn hoặc tự tạo plugin để mở rộng chức năng cho agent.

Quick Start

- Làm ngay tuần này: Cài đặt OpenHarness bằng lệnh

curlvà chạy lệnh demo đầu tiên với API key của bạn. Quan sát cách agent tự động dùng tool để phân tích repository. - Bước tiếp: Thử nghiệm với các LLM provider khác mà bạn đang xài (OpenAI, Kimi, Copilot) để xem khả năng tương thích. Dùng

oh --permission-mode planđể thử chế độ an toàn khi tương tác với code. - Thói quen duy trì: Bắt đầu nghĩ về một tác vụ lặp đi lặp lại trong công việc của mình mà LLM có thể giải quyết nếu nó có “tay chân”. Sau đó, thử viết một custom tool hoặc skill đơn giản cho OpenHarness để tự động hóa tác vụ đó.

FAQ

OpenHarness là gì và nó giải quyết vấn đề gì? OpenHarness là một framework mã nguồn mở giúp biến các mô hình ngôn ngữ lớn (LLM) thành các AI agent có khả năng thực hiện tác vụ thực tế. Nó giải quyết vấn đề LLM chỉ biết “nói chuyện” mà hông có khả năng “làm việc” bằng cách cung cấp cho chúng công cụ, trí nhớ và khả năng phối hợp.

OpenHarness khác gì so với các framework agent khác như LangChain hay LlamaIndex? OpenHarness tập trung vào việc xây dựng một “harness” (bộ khung hạ tầng) nhẹ, có thể kiểm tra được, cung cấp các tính năng cốt lõi như tool-use, skills, memory và governance một cách có cấu trúc. Nó nhấn mạnh vào việc hiểu cách các agent sản xuất hoạt động dưới vỏ bọc, thay vì chỉ là một thư viện wrapper.

Tôi có cần biết code để xài OpenHarness không? Để xài các tính năng cơ bản và chạy các agent có sẵn thì hông cần code. Bạn chỉ cần dùng các lệnh CLI. Tuy nhiên, nếu bạn muốn mở rộng, thêm tool, skill hay plugin tùy chỉnh thì sẽ cần biết Python.

OpenHarness có hỗ trợ những LLM nào? Nó hỗ trợ các API tương thích Anthropic (mặc định), các API tương thích OpenAI (bao gồm GPT, Qwen, Llama, DeepSeek, Ollama local) và cả tài khoản GitHub Copilot của bạn.

Làm sao để đảm bảo AI agent của tôi không làm những việc ngoài ý muốn?

OpenHarness có hệ thống Governance mạnh mẽ với các chế độ quyền hạn đa cấp (Default, Auto, Plan Mode) và khả năng đặt luật ở cấp độ path hoặc chặn các lệnh cụ thể. Nó cũng có các hook để bạn can thiệp vào vòng đời thực thi tool, giúp kiểm soát an toàn tối đa.

Đang tải nội dung...

Xây phần mềm không cần UI

Agent-first development: 3 buổi từ CLI commerce engine → MCP server → website trên Cloudflare.

Xem chi tiết & đăng ký →

Công ty một người: Present, Bán & Vận hành

3-pack cohort cho công ty một người: Skill làm slide, bán & vận hành workshop tự động, vault giữ tri thức compound.

Xem chi tiết & đăng ký →